谷歌最新推出的Cappy模型打分框架以RoBERTa语言模型为基础,旨在提升模型输出内容的准确性和智能性。下面将详细介绍这一创新性框架的特点和应用。

基于RoBERTa语言模型的打分框架

Cappy框架采用了RoBERTa语言模型作为基础,通过检测模型输出的内容并为其打分,以此作为参考基准让模型学习,从而不断优化模型的性能和智能水平。

提升大语言模型输出准确性的“候选机制”

除了作为打分框架,Cappy还可以作为大语言模型的“候选机制”。它内置在模型中,对模型预输出的内容生成分数,并选择分数最高的回应作为最终输出,从而提高了大语言模型输出内容的正确性和质量。

低RAM用量,兼容各种闭源大模型

与其他方案相比,Cappy框架的RAM用量更低,因为它无需访问模型参数。这使得Cappy框架能够兼容各种闭源大模型,包括仅支持通过Web API访问的模型,为模型应用提供了更大的灵活性和可扩展性。

实际纠错性能优越

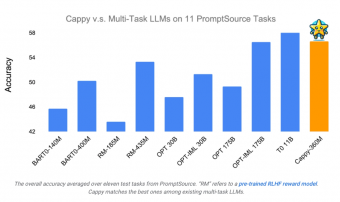

研究人员在使用PromptSource的11项语言理解分类任务中对Cappy框架进行了测试,尽管该框架仅拥有3.6亿参数,但实际纠错性能优于规模更大的OPT-175B和OPT-IML-30B模型,展现出了其在未来发展中的潜力和前瞻性。

谷歌Cappy模型打分框架的推出将进一步推动大语言模型领域的发展,为模型的智能化提供了新的思路和方法。