谷歌最新发布的大语言模型Gemini在一段演示视频中展示了其强大的多模态用户体验。然而,根据谷歌发言人的承认,这段视频并非实时录制,而是通过拼凑静止图像帧和文字提示而成。让我们深入了解这一情况。

演示视频真相揭秘

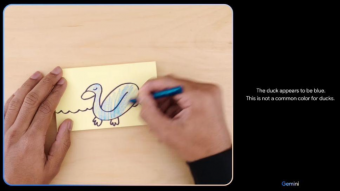

虽然演示视频中Gemini模型似乎能够轻松识别杯中的纸团和图画中的物体,但谷歌发言人透露,Gemini只能对输入的提示和静态图像做出反应。视频中的语音互动也是由后期配音完成的,与实际响应存在延迟。

激发灵感的多模态体验

谷歌DeepMind研究副总裁兼深度学习负责人Oriol Vinyals解释说,这段视频旨在展示Gemini构建的多模态用户体验的“可能的样子”,以激发开发人员的灵感。视频中的所有用户提示和输出都是真实的,但为了简洁起见进行了缩短。此外,视频展示的是Gemini Ultra模型。

Gemini Ultra性能突出

在之前的报道中,谷歌声称Gemini Ultra在32个广泛使用的学术基准测试中有30个表现出超越当前时代的“先进结果”。Gemini Ultra不仅在大规模多任务语言理解(MMLU)上超越人类专家,还在新的多模态任务基准测试中表现卓越。

Bard Advanced即将登场

谷歌计划在明年初推出全新升级的Bard Advanced,为用户提供更出色的模型和功能体验。这将进一步巩固Gemini Ultra在语言理解领域的领先地位。