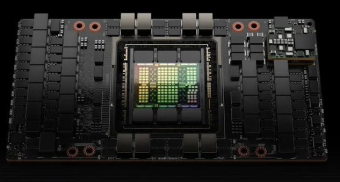

随着人工智能的迅猛发展,对计算能力的需求愈发增长。英伟达的AI处理器H100在市场上广受欢迎,然而其峰值功耗高达700瓦,超过了普通美国家庭的平均功耗。随着H100的大规模部署,专家预测其总功耗将相当于一座美国大城市,甚至超过一些欧洲小国。

H100功耗之谜

去年10月,法国施耐德电气公司估计,用于AI应用的数据中心的总功耗已与塞浦路斯全国相当。而英伟达的H100,作为最热门的AI处理器之一,其究竟有多大功耗?

微软数据中心技术治理和战略部门首席电气工程师保罗・楚诺克(Paul Churnock)在领英上的发帖中预测,到2024年底,数百万块H100部署完毕时,其总功耗将超过美国亚利桑那州凤凰城所有家庭的用电量,但仍低于得克萨斯州休斯敦等更大的城市。

数字揭秘:H100的电力浩劫

按照61%的年利用率计算,每块H100每年将消耗约3740千瓦时(kWh)的电量。假设英伟达在2023年售出150万块H100,2024年售出200万块,到2024年底,将有350万块H100芯片被部署。这些芯片的总年耗电量将达到130.91亿千瓦时,即13091.82吉瓦时(GWh)。

对比国家电力消耗

与此同时,格鲁吉亚、立陶宛或危地马拉等国家的年均电力消耗也大约为13092吉瓦时。尽管H100的功耗令人震惊,但AI和高性能计算(HPC)GPU的效率正在不断提高。因此,虽然英伟达下一代Blackwell架构的B100芯片的功耗可能会超过H100,但它将提供更高的性能,从而以更少的单位功耗完成更多工作。

未来挑战与平衡

随着AI技术的飞速发展,如何平衡算力与能耗之间的矛盾将成为未来亟需解决的重要课题。尽管当前的处理器在性能上取得显著突破,但对环境友好型AI技术的探索和创新也势在必行。